分类

| 机器学习 | 有监督学习(Supervised) | 无监督学习(UnSupervised) |

|---|---|---|

| 理解 | 有一组称之为”正确”的数据提供给算法,用于监督每次的训练成果 | 从数据集中发掘出规律,从而将数据进行某种程度划分 |

| 问题 |

线性回归

模型表示

关键词:训练集(Training Set)| 学习算法(Learning Algorithm)| 假说(Hypothesis)

通过学习算法找到某种假说使得训练集的数据呈现该假说规律,即:H maps from TraningSet

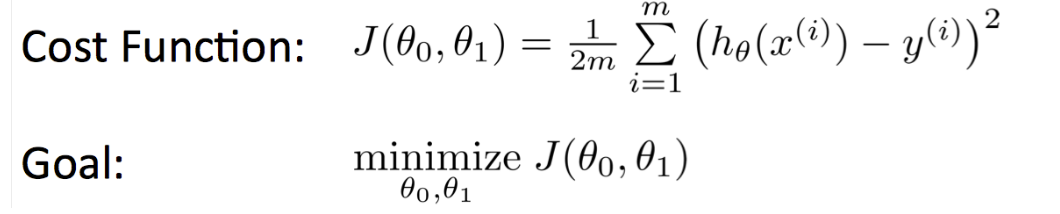

如何检测假说的效果,使用成本函数(cost function or loss function),有时候也叫损失函数,通常来说,假说越准确,越接近真实,其值就越小。成本函数的出现通常伴随着目标,即

When cost function defined,the goal has appearanced线性回归通常使用的成本函数和目标为:

学习算法:

梯度下降法(Gradient Descent)

- 梯度下降法的缺点包括:1)靠近极小值时速度减慢,2)直线搜索可能会产生一些问题,3)可能会“之字型”地下降。

如何调节机器学习的结果:

特征缩放(Feature Scaling)

解释:在运用一些机器学习算法的时候不可避免地要对数据进行特征缩放(feature scaling),比如:在随机梯度下降(stochastic gradient descent)算法中,特征缩放有时能提高算法的收敛速度